当サイトではアフィリエイトプログラムを利用して商品を紹介しています。

過剰最適化(オーバーフィッティング)の正体とリスク

アルゴリズム開発における「数打てば当たる(Spaghetti-on-the-wall)」アプローチは、現代の計算資源を用いれば容易に実行可能だが、同時に極めて危険な罠を孕んでいる。膨大な数のインジケーターやパラメーターの組み合わせを過去データにぶつければ、統計的な偶然だけで優れた結果を出す個体が必ず現れるからだ。これは開発者の知性や意図の欠如ではなく、反復的な仮説検定がもたらす構造的な帰結である。

過剰最適化の主な要因の一つは「データ・スヌーピング・バイアス」である。同じヒストリカルデータに対して繰り返し異なる仮説をテストすると、最終的に選ばれた戦略が単なる「乱数の中のラッキーなドロー」である確率が高まる。10個の候補から選ばれた最良の戦略と、1万個の候補から選ばれた最良の戦略では、その結果が持つ統計的意味合いは根本的に異なる。

また、リサーチの過程で無意識に蓄積される「リサーチャーの自由度」も無視できない。特徴量の選択、パラメーターの範囲設定、ルールの構造決定など、テスト結果を観察しながら行うあらゆる修正が、最終的な結果の有意性を膨張させる。XMTradingやExnessなどのハイレバレッジ環境でEAを運用する場合、こうした目に見えないバイアスが原因で、想定外のロスカットを招くリスクは非常に高い。

重要なのは、広範な探索自体を否定することではない。探索によって得られた「エッジ」が、統計的なアーティファクト(人工物)なのか、それとも将来も持続可能な真の優位性なのかを判別する厳格なインフラを構築することである。そのための第一歩が、リサーチのライフサイクルを構造化することだ。

データ・スヌーピング・バイアスの数学的限界

有限のデータセットに対してテスト回数を増やすほど、偽陽性(本来は無効な戦略を有効と判定すること)の確率は100%に近づく。これは多重比較問題として知られており、金融データのようにS/N比(信号対雑音比)が極めて低い分野では特に顕著である。

例えば、有意水準5%でテストを行う場合、20個のランダムな戦略をテストすれば、そのうち1つは偶然に「有意である」と判定される計算になる。1,000個の戦略をテストすれば、50個の「偽のエッジ」が発見される。このバイアスを補正するためには、テスト回数に応じた閾値の調整が必要不可欠となる。

V-in-Vによるリサーチ・ライフサイクルの管理

標準的なウォークフォワードテストには、隠れた欠陥が存在する。開発者が検証結果を見てパラメーターを微調整したり、特徴量を削ったりするたびに、本来「アウト・オブ・サンプル(未知データ)」であるはずの期間が、事実上の「トレーニング・セット(学習データ)」へと変質していくからだ。これを防ぐために、ティモシー・マスターズが提唱したのが「V-in-V(Validation-within-Validation)」である。

V-in-Vのアーキテクチャは、データを以下の3つの層に厳格に分割する。

- 外部トレーニング・セット(約60%):広範な探索、パラメーター最適化、正規化などが行われる領域。

- 内部バリデーション・セット(約20%):候補となる戦略の絞り込み(ショートリスト作成)に使用される領域。

- 最終テスト・セット(約20%):戦略が完全に固定された後、生涯で一度だけ開封される領域。

この3層構造により、リサーチャーの自由度による汚染を最終テストから隔離することが可能になる。最終テスト・セットの結果を見て戦略を修正することは許されない。もし修正を行うのであれば、そのテスト結果は無効となり、全く別の新しいデータセットを用意しなければならない。

アンカー付きウォークフォワードの拡張

データの分割は統計的に健全だが、実務上はサンプルサイズの不足という問題に直面する。5年間の日足データ(約1,250バー)を用いる場合、20%の最終テスト・セットはわずか250バーに過ぎない。これではシャープレシオの信頼区間を推定するには不十分であり、相場環境の激変(レジームシフト)への耐性を測ることもできない。

この解決策が「アンカー付きウォークフォワード(Anchored Walkforward)」である。これはトレーニング・セットの開始点を固定し、時間を進めるごとに窓を広げていく手法だ。各ウィンドウにおいて、内部バリデーションと最終テストの境界を維持しつつ、評価を繰り返す。これにより、限られたデータを最大限に活用しながら、異なる相場環境下での堅牢性を確認できる。

実装例:V-in-V アンカー付きウォークフォワード

以下に、Pythonを用いたV-in-Vパイプラインの構造例を示す。このコードは、データの時系列順序を厳格に守りながら、3層のパーティションを構築するものである。

def vin_v_anchored_walkforward(X, y, t1, estimator, n_splits=5):

n = len(X)

# データを3つのゾーンに分割

outer_end = int(n * 0.6)

val_end = int(n * 0.8)

X_outer, y_outer = X.iloc[:outer_end], y.iloc[:outer_end]

X_inner_val, y_inner_val = X.iloc[outer_end:val_end], y.iloc[outer_end:val_end]

X_final, y_final = X.iloc[val_end:], y.iloc[val_end:]

# 第1フェーズ:外部トレーニング内での探索

# 第2フェーズ:内部バリデーションでの絞り込み

# 第3フェーズ:最終テスト(一度きりの評価)

return resultsCPCV(組合せ的パージ済み交差検証)の仕組み

機械学習の標準的な「k-分割交差検証(k-fold CV)」は、金融時系列データに対しては構造的に不適切である。なぜなら、金融データは「独立同一分布(i.i.d.)」の仮定を著しく逸脱しているからだ。例えば、20日移動平均線を特徴量に含める場合、ある日のデータはその前後19日間のデータと情報を共有している。

この状態でデータをランダムに分割してトレーニングとテストを行うと、テストセットの情報がトレーニングセットに「漏洩」する。その結果、バックテストの成績は不自然に向上し、リアル運用では通用しない戦略が出来上がる。マルコス・ロペス・デ・プラドが提唱した「CPCV(Combinatorially Purged Cross-Validation)」は、この情報漏洩を物理的に排除する。

CPCVの核心は「パージ(Purging)」と「エンバーゴ(Embargoing)」、そして「組合せパス」の3点にある。パージはテスト期間と重なるラベル形成期間を持つトレーニングデータを削除し、エンバーゴはテスト期間直後のデータを削除することで、特徴量のラグによるリークを防ぐ。さらに、全ての分割の組み合わせからバックテスト・パスを再構成することで、単一の分割結果に依存しない評価を可能にする。

パージとエンバーゴによるデータの浄化

パージング(Purging)は、テストセットの期間とオーバーラップするすべての観測値をトレーニングセットから取り除くプロセスである。金融データでは、現在のラベル(例えば5日後の収益率)が未来の情報を含んでいるため、この処理を行わない限り、未来の情報を「カンニング」して学習することになる。

エンバーゴ(Embargoing)は、テストセットの直後の期間を一定量削除する処理だ。時系列データには自己相関が存在するため、テストセットの直後のデータはテストセットの内容と高い相関を持っていることが多い。これを取り除くことで、より厳格な未知データへの適応力を測定できる。TitanFXやAxioryのような低スプレッド業者を利用する場合、こうした微細なエッジの検証が収益性を左右する。

組合せバックテスト・パスの生成

CPCVのもう一つの利点は、複数の「バックテスト・パス」を生成できる点にある。通常の交差検証では、各テストフォールドの結果を単純に集計するだけだが、CPCVでは分割の組み合わせ(N個のグループからk個をテストに選ぶ)を全て網羅し、それぞれを時系列順に結合して完全なバックテスト結果を複数作成する。

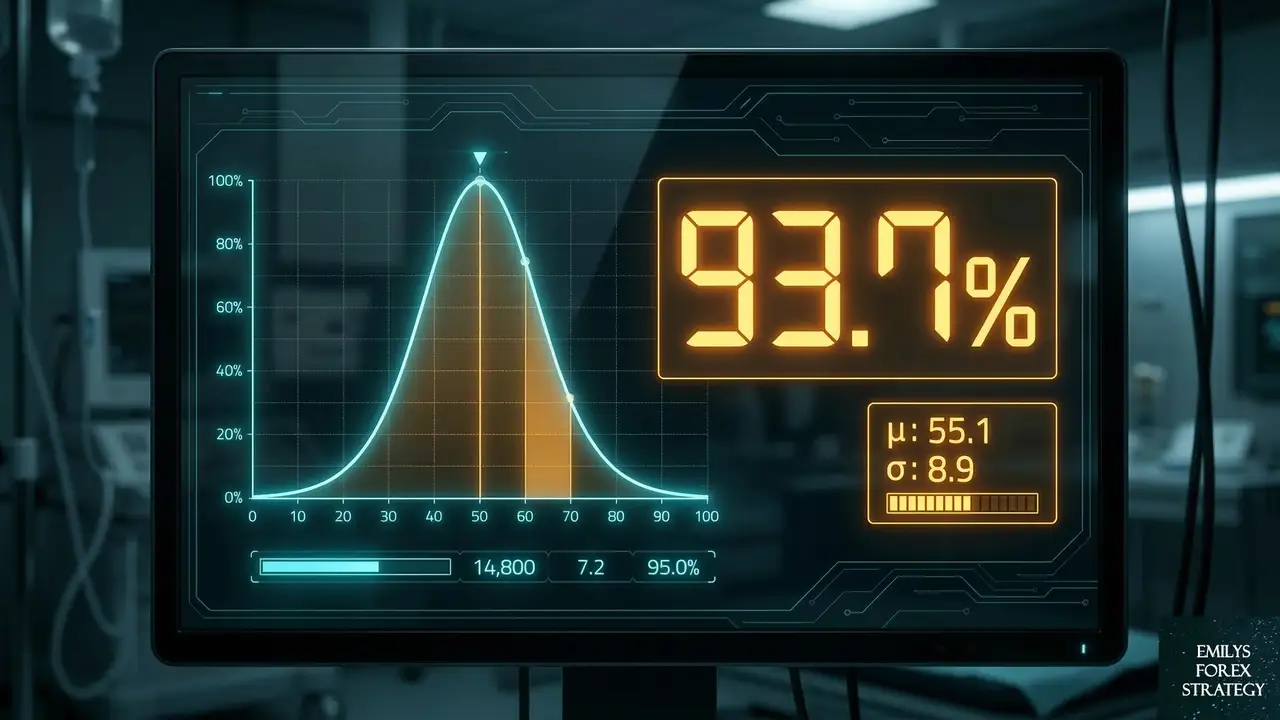

これにより、戦略のパフォーマンスを単一の数値(平均シャープレシオなど)ではなく、分布として捉えることができる。パスごとの成績のばらつきが小さく、かつ全体としてプラスであれば、その戦略は特定の時期や分割方法に依存しない「ロバスト(堅牢)」なものであると判断できる。

CSCV(組合せ的対称交差検証)とPBOの算出

バリデーション・パイプラインの最終段階として機能するのが「CSCV(Combinatorially Symmetric Cross-Validation)」である。これは戦略を保護するツールではなく、リサーチプロセスそのものを「診断」するためのツールだ。CSCVの出力は、**PBO(Probability of Backtest Overfitting:過剰最適化確率)**という具体的な数値で示される。

PBOは、「インサンプルで最良だった戦略が、アウトオブサンプルでも中央値以上の成績を収める確率がどの程度あるか」を測定する。PBOが0.5に近い場合、その選択プロセスは「コイン投げ」と同等であり、インサンプルでの最適化がアウトオブサンプルの結果に対して何ら予測力を持っていないことを意味する。

CSCVは、データをS個のサブセットに分割し、その半分をインサンプル、残り半分をアウトオブサンプルとして全ての組み合わせ(C(S, S/2))を検証する。このプロセスを通じて、開発者は自らの手法選択プロセスが統計的に信頼できるものかどうかを客観的に評価できる。

PBOの解釈と閾値

一般的に、PBOは0に近いほど望ましい。PBOが0.1〜0.2以下であれば、その選択プロセスは真のエッジを捉えている可能性が高いと判断される。逆に、PBOが0.4を超えるような戦略は、どれほどバックテストの結果が良くても、それは単なるデータのフィッティングに過ぎない可能性が高い。

注意すべきは、CSCV自体は過剰最適化を修正するものではないという点だ。高いPBOが算出された場合、それは「特徴量の選択からやり直す必要がある」あるいは「戦略の複雑さを下げるべきである」という警告として受け取るべきである。Exnessなどの無制限レバレッジを提供する業者で大きなポジションを持つ前に、この数値を算出することは、破産確率を下げるための最も合理的な投資と言える。

統合パイプラインの実装と優先順位

ここまで解説した3つの手法をどのように組み合わせるべきか。理想的なパイプラインは以下の順序で構成される。まず、CPCVを用いて各トレーニング/テストの評価から時系列的な漏洩を排除する。次に、V-in-Vの枠組みの中でリサーチのライフサイクルを管理し、最後にCSCVを用いてプロセス全体の健全性を監査する。

これら全てを一度に実装するのは困難だが、優先順位をつけるならば以下のようになる。

- CPCV(パージ済み交差検証):金融データを扱う以上、時系列リークの排除は非交渉の必須事項である。

- V-in-V(3層分割):反復的な開発を行う場合、人間の意思決定による汚染を防ぐ仕組みが不可欠である。

- CSCV(PBO算出):外部への説明責任や、組織的な運用を行う際の最終監査として極めて有用である。

Swift TraderやHFMのような新興業者、あるいは老舗のXMでEAを稼働させる際、バックテストの数字だけを信じるのはあまりに無防備だ。本記事で紹介した統計的アプローチを導入することで、バックテストは「希望的観測」から「科学的な予測」へと進化する。

各手法がカバーする脅威の比較

| 手法 | 主な対象フェーズ | 対処する脅威 | 主な出力 |

|---|---|---|---|

| CPCV | モデル構築・評価 | 時系列データ間の情報漏洩 | クリーンなパフォーマンス分布 |

| V-in-V | 開発ライフサイクル全体 | リサーチャーによる無意識のバイアス | 3層に保護された検証構造 |

| CSCV | 最終監査・選択 | 選択バイアス・最適化の失敗 | 過剰最適化確率(PBO) |

アルゴリズムトレードの成功は、優れたエントリーロジックを見つけることではなく、劣悪なロジックをいかに効率的に排除できるかにかかっている。統合バリデーション・パイプラインは、そのための最も強力なフィルターとなるだろう。

出典

- MQL5「Unified Validation Pipeline Against Backtest Overfitting」

- Marcos Lopez de Prado「Advances in Financial Machine Learning」

- Timothy Masters「Advanced Algorithms for Neural Networks」

億トレーダーのエミリーです。

FXトレードで資産1億円を達成後、培った知識と経験を初心者にも分かりやすく伝えることをライフワークとしています。独自開発のブレイクアウト手法と徹底したリスク管理が特徴。

初心者の方でも着実にステップアップできるよう、基礎知識から高勝率なトレード手法まで徹底的に解説・検証しています。FXで一緒に夢を叶えましょう!